本文共 1653 字,大约阅读时间需要 5 分钟。

我这篇博文之前说了

今天又看到一些

这里也说出了T265的不足。

阿木3D打印的相机挂件也是弄了两种,估计也是考虑到了会组合使用?

阿木的无人车也是放了T265和D435i

摘自:

论文介绍 : 使用T265和D435i进行地图定位和深度数据的耦合

公众号「当SLAM遇见小王同学」, 欢迎交流学习

声明:本文首发于我的公众号【当SLAM遇见小王同学】,谢绝私自转载,如有需要,可加我微信进行授权!!侵权必究!

今日分享arXiv:2004.00269

Coupling of localization and depth data for mapping using Intel RealSense T265 and D435i cameras

题目: 使用Intel RealSense T265和D435i相机进行地图定位和深度数据的耦合

摘要

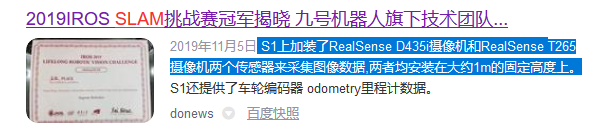

为了获得室内环境的定位和三维occupancy图,我们使用T265和D435i.我们用多线程方法实现了一个基于python的摄像机数据同步观察模式.

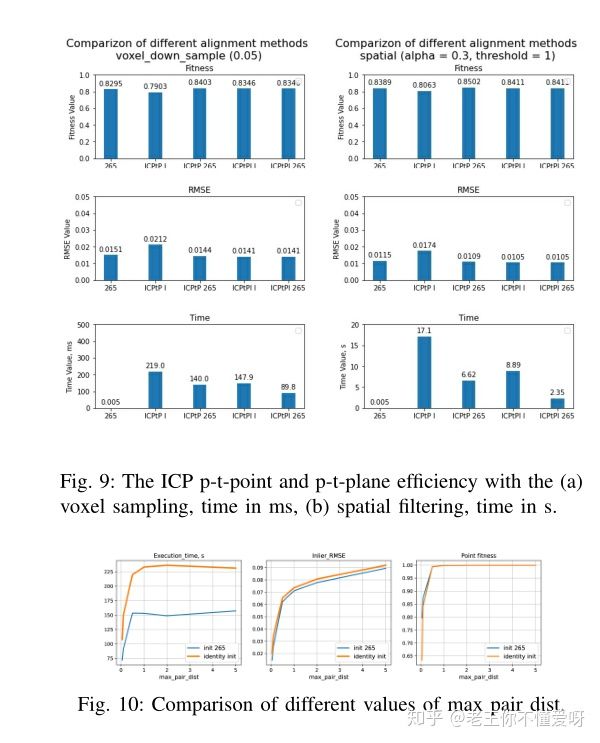

我们比较了不同的点云对齐方法(使用从跟踪摄像机和ICP方法获得的变换),跟踪摄像机和PC机的对齐允许我们在帧之间生成一组变换.基于这些变换,我们得到了不同的轨迹并进行了分析.最后,对所有帧进行姿势设置,合并深度数据.首先,我们得到了一个表示整个场景的联合PC,然后我们使用Octomap表示来构建一个映射.

主要算法如下

1)从T265中提取跟踪(姿态)数据和从D435i相机中提取深度数据

2)同步来自相机的数据(按时间戳)

3)Compare/build算法,该算法能够使用深度和跟踪相机当前数据的融合去不断更新先前的轨迹和地图

数据集获取

使用的库

- Open3D

- Pyrealsense

- Threading

- NumPy

- Matplotlib

- OpenCV

- PPTK

- Octomap

- Pyglet, trimesh

在实验过程中,我们使用来自T265和D435i传感器的数据来估计轨迹。首先,根据从T265传感器得到的变换矩阵建立轨迹。据推测,T265传感器数据相当准确。然而,它容易产生测量误差。因此,决定尝试利用D435i传感器获得的点云观测数据来改进轨迹估计.

Mapping

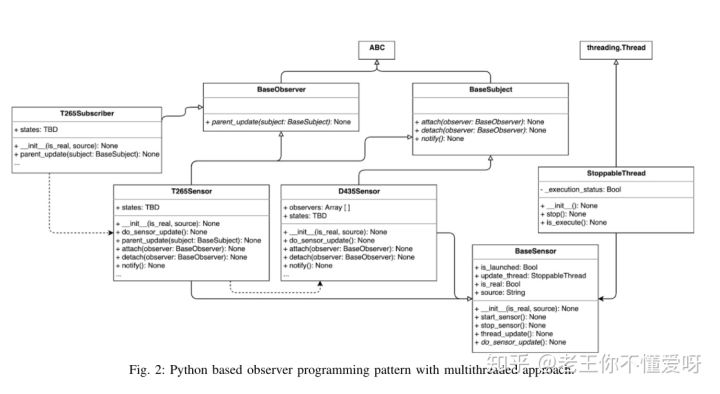

在我们的项目中,我们记录了D435i和T265传感器同时工作的一些数据集。所以,传感器观察到了一些区域。我们的任务之一是使用获得的数据集重建整个观测区域的地图。首先,为了实现这一目标,我们需要将一组全局点云合并并构建在一个初始坐标系中。为此,我们在前面提到的关键帧之间使用已计算的变换矩阵d1td2迭代组合相应的帧。所有操作都是通过Open3D库完成的。组合的结果如图17所示。为了更好的可视化,进行了下采样。生成的点云的形状完全对应于真实世界,从而可以得出所有转换都正确完成的结论

下一步是使用Octomap模块重建地图本身。我们决定避免在ROS(机器人操作系统)中使用Octomap,以使表示更适合不同的操作系统。Octomap之所以被选中,是因为它的清晰度和稳定性。对于地图可视化,首先选择了PPTK模块。在图18中,提供了彩色合成点云与重建地图的比较

如上图所示,Octomap提供了用于地图表示的占用点的良好计算。然而,PPTK模块并没有提供具有体素的3D地图的传统表示。因此,传统的彩色表示是用pyglet模块实现的,图19从蓝色到红色表示从地板到天花板的方向.

其他细节可参考论文

最后再附上一些细节图

发布于 06-20

我看闲鱼上有卖这种把ST265和D435i固定在一起的板子

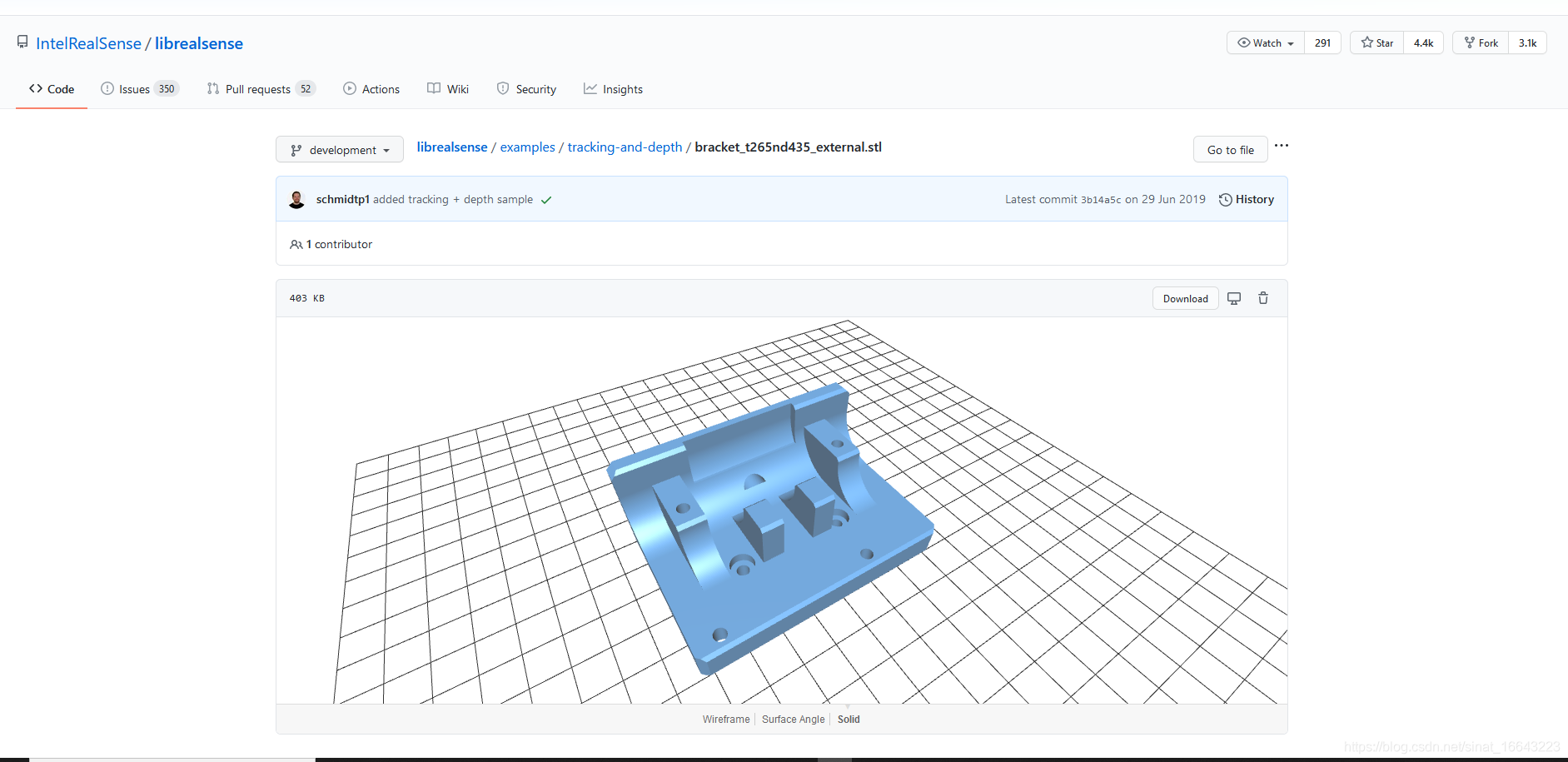

我发现realsnese官方提供了T265和D435i固定件3D打印模型,就在github上!!!!

最开始是在阿木的普罗米修斯项目看到的

智能无人机课程里面讲到的

D435i直接输出深度图,内置商业算法

建图 T265适合定位 两个合起来就是定位和建图(SLAM不就是同时定位与建图,怪不得用T265和D435i)